PG电子(中国)官方网站亲历中国智驾大战吴新宙加入NVIDIA半年后首秀吴新宙近日现身NVIDIA GTC,这是其从小鹏汽车离开加入NVIDIA之后的首次公开亮相。

吴目前担任NVIDIA汽车事业部副总裁,全面负责NVIDIA的车载计算产品线DRIVE平台的产品定义以及工程落地工作。吴新宙最广为人知的经历,是在中国市场与小鹏汽车一起打造彼时最强的智驾系统,可以说是推动智驾量产数一数二的领军人物。

在GTC的现场,吴新宙发表了题为《加速向AI定义汽车时代转变》的演讲,介绍了NVIDIA对于AI以及汽车变革的思考:

在吴新宙看来,自动驾驶的研发重心将向云端转移,随着软件定义汽车的成熟,以及要解决更多的Corner Case,自动驾驶会迎来新的开发范式。生成式AI和LLM,将有可能解决这些更复杂的问题,打造一个真正类人的高阶自动驾驶技术栈。

我是吴新宙,担任NVIDIA汽车事业部副总裁。我是最近在6个月前加入的NVIDIA,负责整个汽车业务部门,主要职责是为Drive平台制定产品定义,以及做好相应的工程落地。

今天,我将谈谈「AI定义汽车」,这一不可逆转的未来趋势,以及NVIDIA在这一领域正在做什么,从而加速向人工智能定义车辆的转变。

按照议程,首先我将谈一谈我们的发展历程,以及驱动下一波创新并将其应用于AI定义汽车的主要因素是什么,之后是NVIDIA在这个领域做了什么。

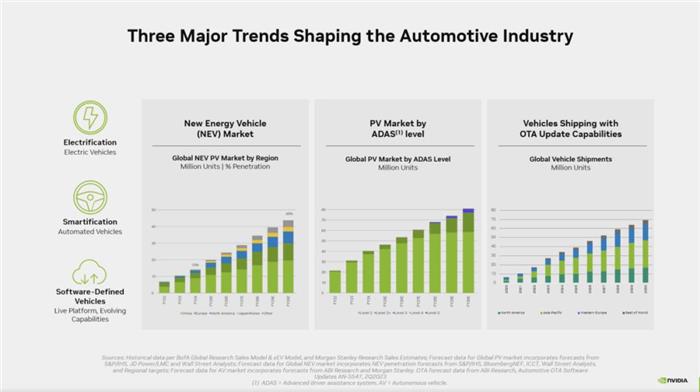

过去十年的汽车行业发生着诸多令人惊叹的变化,也许是百年汽车业未曾见过的。我认为,过去10年,三大趋势对汽车行业进行了重新定义。

第一,电动化。为了建设一个更清洁、更环保的世界,汽车行业已经采取措施引入越来越多的电动汽车。这里有一些数据,我认为总体预测来看,到2030年在全球范围内的新能源渗透率将在20% - 30%之间。

第二,智能化。这一点也非常重要,基本上是为座舱和自动驾驶引入更智能的能力,本质上是对人类出行的辅助。

我们都知道摩尔定律,Jensen也谈到加速计算是如何定义摩尔定律。汽车行业很好地代表了这种,超级摩尔定律在过去十年中带来了诸多迅速的变化。

就NVIDIA而言,我们的第一个产品是Tegra Parker,然后又推出了25 TOPS的Xavier。在那之前,市场上的产品都是2 TOPS级别。当我们推出Orin X时,与Xavier相比,算力又扩大了10倍。

今天我将谈谈下一代平台,也是最新一代的为汽车而生的超级计算机,大概是Orin X的4到5倍。

众所周知,自动驾驶处于进行时,我有一些中国市场的经验。今天在中国,如果一辆车没有一些先进的ADAS功能就很难卖出去。例如,像华为这样的头部品牌,选配与不选配高阶智驾功能的比例,基本是4:1。

这说明,ADAS能帮人开车,缓解驾驶焦虑和疲劳,我认为这股浪潮最终会在全球范围内发生,我们将在未来十年看到,对汽车智能化功能的需求越来越多。

第三,OTA能力。购买可以OTA的车,意味着买车不是买硬件,而是买服务。买完车后,它在持续学习、进化,不断获得新功能。今天拥有一辆能进化的汽车,是非常令人兴奋的。

第一,对于几乎所有主机厂而言,随着软件定义汽车逐渐成熟,甚至几乎每辆车都可以变得非常舒适,软件定义汽车已经无处不在。

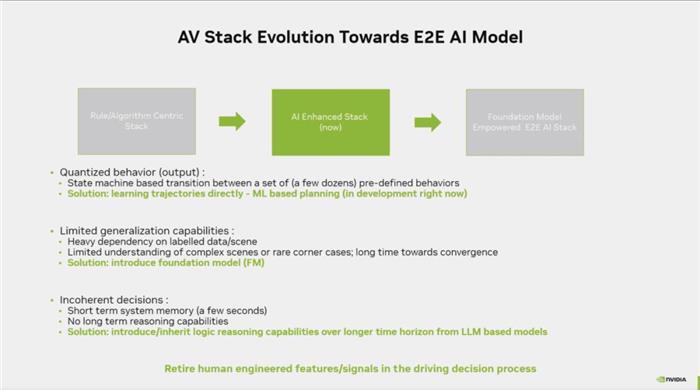

第二,自动驾驶堆栈的演变,从一个经典的堆栈开始,然后我们使用AI来增强感知的组件,它会进入一个端到端的自动驾驶模型的堆栈。

这就是生成式AI。有了Transformer、LLM、VLM和稳定扩散,我们看到了很多基于生成式AI的惊人的基本能力和新能力。与我们熟悉的基于卷积的人工智能相比有本质区别,它实际上是关于在空间和时间上创造交叉注意力的能力。

卷积网络仍然是基于接近度的,试图找到特征,查询特征,空间或时间,显然我们使用的是IM类型的时间结论。但有了Transformer,我们可以获得图像中任何两个像素在时间和空间上的相关性PG电子(中国)官方网站,这将大大增强我们理解复杂事物的能力。与时态相同的是,具有注意力交叉的能力。

现在我们可以进行长期推理了,这是一个非常困难的问题,人工智能几十年来要实现的目标,是能够跨时间,也就是跨秒、跨分钟甚至跨小时进行推理。有了LLM,我们已经证明网络能够在整个人类文学中进行训练,这是一个非常重要的突破,如今,我们又在目睹AI在视频领域的突破。

我认为这是另一件非常重要的事情,这无关生成式AI,而是我们存在的基石,大家知道人工智能是如何迅速地向我们走来的。

然后是AI增强堆栈。我们首先使用卷积基础网络进行感知,然后使用基于Transformer的网络进行感知BEV的体现。现在,这一趋势也正体现在规划中。

第一,堆栈,我们试图做的是真正量化人类的驾驶行为。这是什么意思?有一个模块叫做行为规划。相信你们中的许多人都在做自动驾驶,所以这个概念对这里的许多观众来说应该不是什么新鲜事。

对于行为规划,它实际上是试图定义一些行为,然后建立一个状态机来在它们之间转换,基于不同的条件,例如,LCC,一种车道居中控制。

所以,最终人们会引入几十种不同的行为。例如,当变道时,如果知道相邻车道有车不让你这样做,你会在车道上停留一段时间,直到观察清楚对方要做什么,然后采取下一步行动。

所以,为了更好地进行行为规划,一个好的堆栈会引入越来越多的行为,让它变得越来越像人,但发现在这种看似像人的行为背后,它仍然是一组离散的行为,系统在它们之间转换。

这实际上并不聪明,因为即使对于最先进的堆栈,有时你仍然会觉得这是非人驾驶,对吧?因为我们很难量化人的行为。

第二,这也是众所周知的,受限的泛化能力。我们在很大程度上依赖于数据标注的数据集,尤其是我们看到和理解基本复杂事物的能力非常有限。如果该数据未被学习和训练,则对其进行标注。我们应该引入基础模型,我会在下面的PPT中进行更多讨论。

第三,在自动驾驶堆栈中做出连贯的长期决策的能力,这是非常困难的,因为这个堆栈的大部分,我们现在拥有的堆栈,它仍然是一种瞬态的内存系统,我有时把它描述为一条鱼7秒的记忆,这就是堆栈的现状。

在很多方面,对于一个真正类人的高阶自动驾驶堆栈,需要更多的功能。我们中间的许多人可能都有在机场找租车还车处或在机场找停车场的糟糕记忆。你目标很简单,但你知道,通常导航不会马上把你带到那里,或者机场正在施工,你必须依靠你所看到的现状,并努力在几十分钟内做出一致的决定,找到合适的路径,这种能力一直是人工智能的一大限制。

有了生成式AI和LLM,我认为我们将能够解决这样复杂的问题,我们将能够制造一个机器人或一辆可以长时间做出连续决策的人工智能汽车。

简言之,我们所做的事情有一些局限性。即使目前的第一块和第二块取得了非凡的成就,但随着生成式AI的新能力,天花板会更高。

基本上,我们在未来看到的是模型PG电子(中国)官方网站,自动驾驶堆栈将成为端到端的模型,它将在具有大量数据的云中进行训练。更重要的是,它还将在具有模拟能力的云中进行验证。NVIDIA在Omniverse和Drive Sim上的投入已有多年,我认为仿真的黄金时段已经到来,但在未来会更加重要。

有了仿真功能和端到端大模型,你可以发现,自动驾驶的开发重心将进入云端,而不是让庞大的工程师和庞大的车队在路上行驶。现在,您需要云计算中的大型服务器,这对NVIDIA来说是好事,我们正在实现这一点。这就是未来的道路。

很明显,在车辆中,我们将进行模型部署,在未来,OTA基本上只会进行模型更新PG电子(中国)官方网站,但让数据返回到云中非常重要,以不断完善云中的大模型。这就是我们所看到的未来。

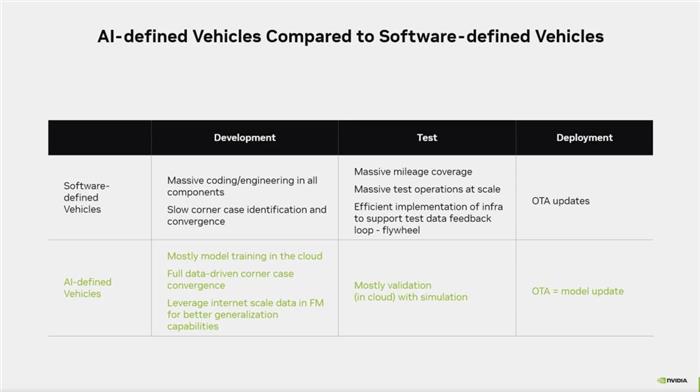

所以,对于软件来说,划分一个我们所知道的车辆,我已经花了10年的时间来研究它,部署工作真的非常繁重。几乎所有的组件都需要大量的编码、工程师和工程,这个堆栈非常深,在路上找到他们的Corner Case识别确实需要很多时间。

L2的ADAS系统不一定是完美无瑕的,但当我们朝着L3和L4的方向前进时,当我们让人脱手时,基于安全性和Corner Case等要求,识别能力就变得非常重要。

正如我们所了解,Corner Case将变得越来越少,越来越难以识别。我们必须依靠庞大的车队才能找到这些Corner Case,但这是一个非常困难的过程,必须能够开发一种非常复杂的机制,无论何时发生这种事情,都能够识别或触发记录。

比如,测试基本上是大规模的里程覆盖。所以通常情况下,人们或汽车厂商只愿意在他们测试过的区域发布软件,这是一种常见的做法。意味着用要数百辆的测试车队进行数十万英里的测试。

你需要一个非常高效的基础设施实现,以便能够支持测试和数据回传,并使用这些测试数据来支持开发,我们称之为数据飞轮。

我们希望在AI定义汽车时代,简化传统的大规模的运营和OTA部署工作,让大量的工程师成为云计算的巨大力量。我们将大部分训练在云端进行,测试将主要在模拟中进行验证,OTA更多是为了大模型。NVIDIA正在做一些事情来实现这一点,那就是加速人工智能时代定义汽车这一趋势。

所以,Drive平台几乎是端到端的,从芯片到安全平台,再到全栈,我的团队很大一部分工作是开发Full Stack-NDAS 堆栈和数据中心基础设施。

Thor,这是我们这一代的超级计算机。它具有1000 Tops的计算机功能,是上一代芯片Orin X的4倍。包括630K DMIPSCPU算力,是Orin X的2.5倍。我们的主机厂合作伙伴越来越多,包括中国的自动驾驶开发商OEM,包括理想汽车和比亚迪。

我们所做的一个重要改变是在Thor和Blackwell Hopper中,基本上是FP4,浮点4位,支持计算机的操作系统。这实际上非常重要,因为当内存带宽限制为4位时可以进行更有效的计算。

有了这些改进,就可以实现4倍于Orin X的提升。通过一些技巧,我们希望基于LLAMA-7B模型实现9倍的提升,Thor可以原生支持Transformer,相信可以成为支持人工智能的开放Soc。

这就是NVIDIA的Drive平台,从芯片到云。我们有两台计算机,一台在车里,另一台在云中。

我们正在做很多工作,比如,在推理芯片和云端芯片中,引入大规模的生成式AI兼容计算能力,我们正在非常努力地使这一过程中的每一步都成为安全客户端。在软件方面,我们正在引入生成式AI和基础模型,以填补推理模型和模拟的未来能力。

未来,我们希望Drive是一个开放的平台。如果OEM希望一直合作,我们是非常开放的。如果只是想从我们现有的东西中获得一部分服务,我们也很乐意与之合作。

我们会再次看到,汽车的计算机将开始引入这种端到端的基于模型的能力。同时,仿真能力也非常重要,我们将努力地实现像素场景和行为等的保真度。此外,我们还将引入基础模型作为人工智能模型。谢谢大家。